利用硬件、系统和机器学习方面的进步,盲人或视力不佳的人可以使用 iPhone 和 iPad 轻松导航到目的地,Apple 预览了一组新的辅助功能,预计将在即将推出的 iOS 中获得16 更新,包括识别门以及它们是否关闭或打开、在 iPhone 上镜像 Apple Watch 屏幕、将语音转换为文本的功能,甚至在视频中或来自您周围的人,让聋哑人或有困难的人更容易上网听力等等。

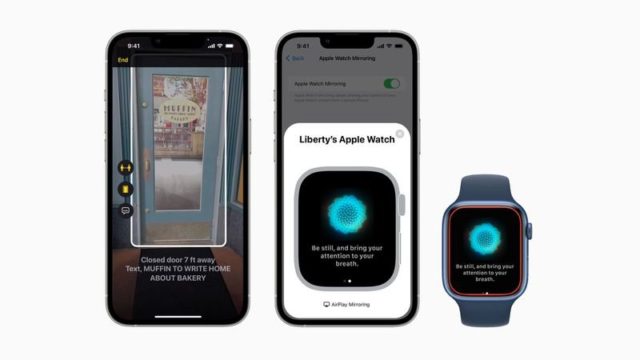

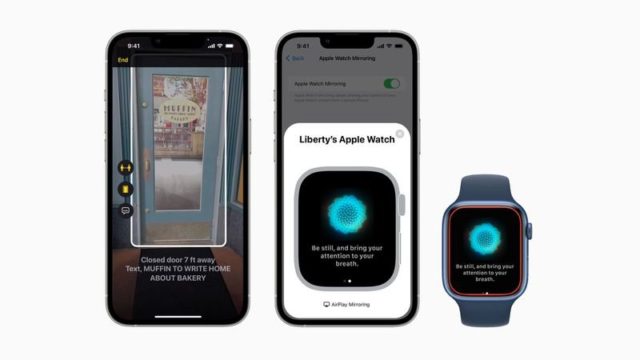

例如,门检测将允许盲人或视障人士使用他们的 iPhone 或 iPad 来定位门何时到达、门的距离和关闭程度、描述门及其组件(如把手)是否打开或关闭,以及是否打开或关闭。可以通过推拉打开,以便读取门上或旁边的标志和符号,例如办公室的房间号,甚至是指纹机的存在或编写访问代码,

该功能将成为放大镜应用程序中新的“检测模式”设置的一部分,除了我们提到的有关此新功能的所有内容之外,它还将检测人物、照片及其描述。

门检测仅适用于支持 LiDAR 扫描仪的 iPhone 和 iPad,并将结合 LiDAR、摄像头和设备上机器学习的强大功能。

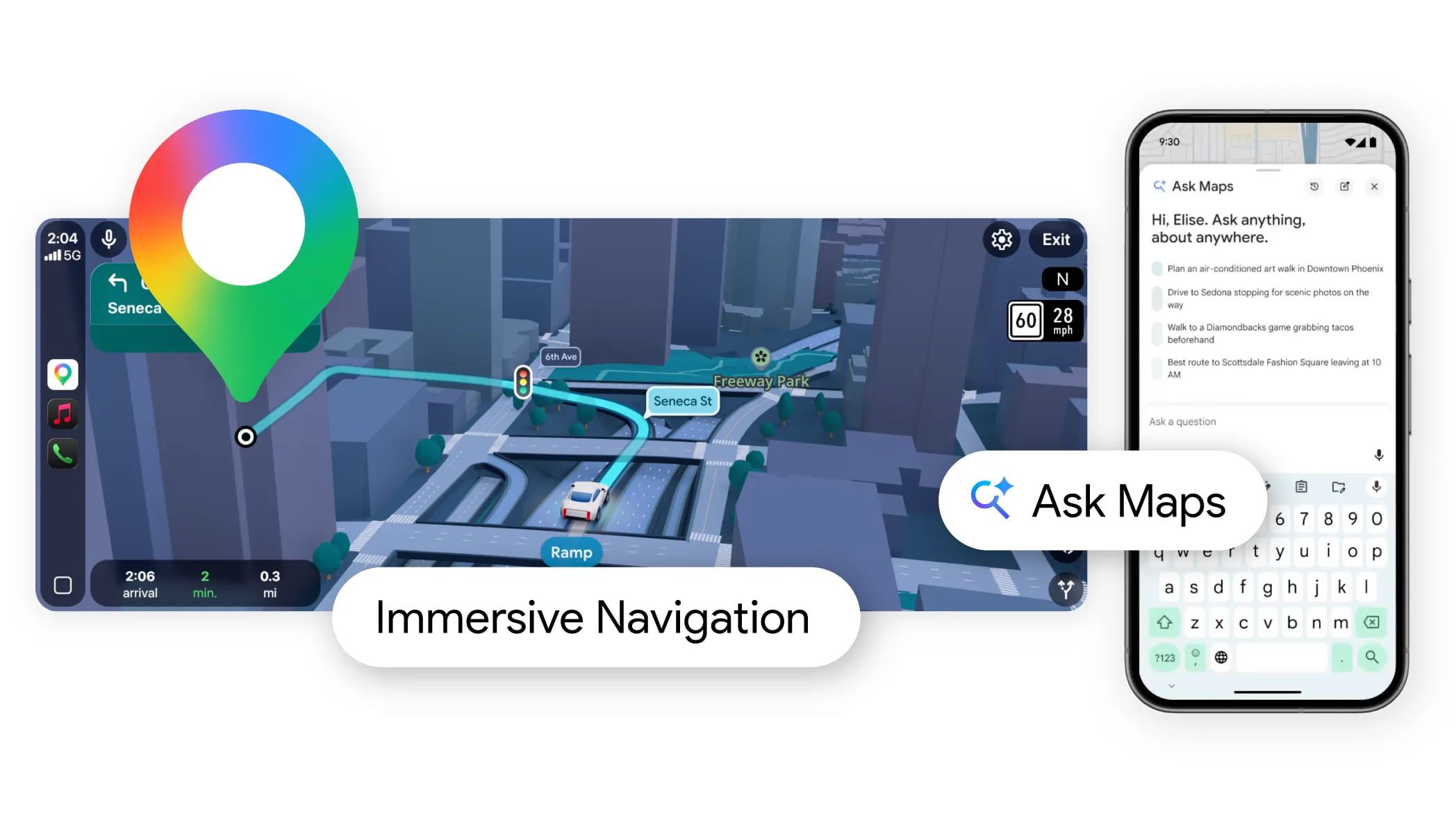

除了放大镜应用程序中的导航工具外,Apple Maps 还将向 VoiceOver 用户提供语音和触觉反馈,以获取步行路线。

使用更多 Apple Watch 改善可访问性

可能依赖语音控制和开关控制的身体残疾用户将能够完全控制 Apple Watch 6 和 iPhone 7,用户可以通过简单的手势来控制 Apple Watch,作为 Apple Watch 上的新快捷操作。将允许用户使用双手拨号手势接听或挂断电话、关闭通知、拍照、在“正在播放”或“正在播放”应用程序中播放或暂停媒体,以及开始、停止或恢复健身房锻炼.

为失聪和听障用户提供实时反馈功能

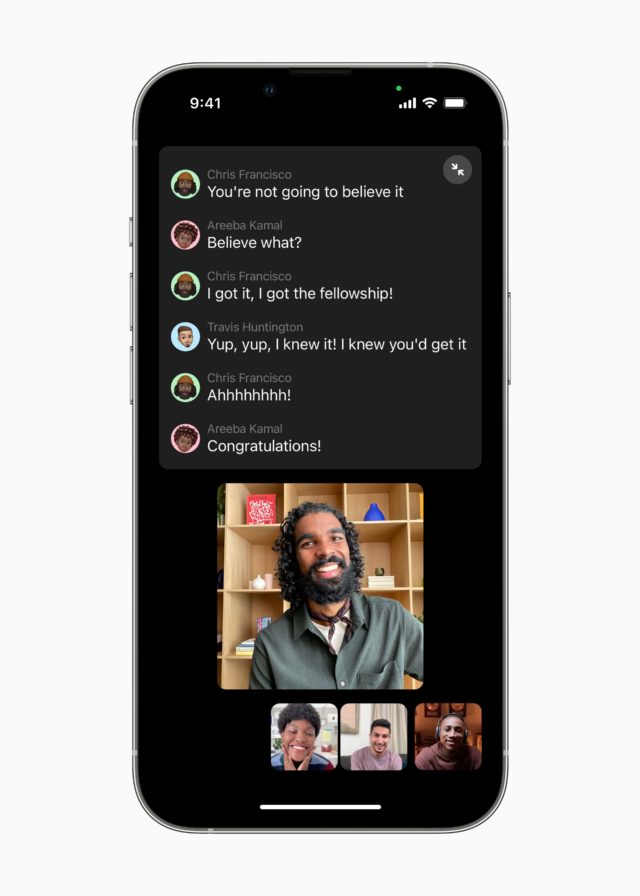

失聪用户和听障人士将能够在 iPhone、iPad 和 Mac 上使用实时字幕。 这使得跟踪任何音频内容变得更加容易,例如在打电话、观看视频和音频内容,甚至是面对面通话、视频会议、社交媒体、任何媒体应用程序、广播或与旁边的人聊天时。

在 Mac 上使用 Live Captions 进行通话时,用户可以选择输入回复,并实时向参与对话的其他人大声朗读。 因为实时反馈是在设备上生成的,所以用户信息保持私密和安全。

Live Captions 英文版将于今年晚些时候在 iPhone 11 及更新机型、配备 A12 仿生处理器及更新机型的 iPad 机型以及 Silicon Mac 电脑上提供测试版。

苹果为 VoiceOver 添加新语言

Apple 将扩大对 VoiceOver 的支持,它是为盲人和视障用户设计的屏幕阅读器,新增 20 种语言,包括孟加拉语、保加利亚语、加泰罗尼亚语、乌克兰语和越南语。 此外,用户将能够从数十种新改进的跨语言声音中进行选择,此外,Mac 上的 VoiceOver 用户可以使用新的文本检查器或文本调整器来查找文本中的格式问题,例如替换中的重复空格或大写它们,这使检查文档或电子邮件变得更加容易。

ميزاتإضافية

◉ 通过好友控制器,用户可以请朋友帮助他们玩游戏; Buddy 控制台将任意两个控制器组合到一个游戏中,因此多个控制器可以将输入定向到单个玩家。

◉ 通过 Siri 暂停时间,有语言障碍的用户可以设置 Siri 在响应请求之前等待的时间。

◉ 语音拼写控制模式使用户可以选择使用逐个字母输入来指示自定义拼写。

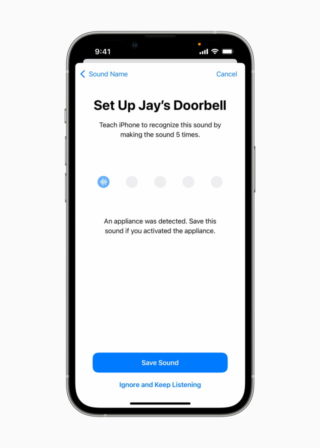

◉ 可以自定义语音识别以识别特定于人的环境的声音,例如他们家的警报、门铃或电器。

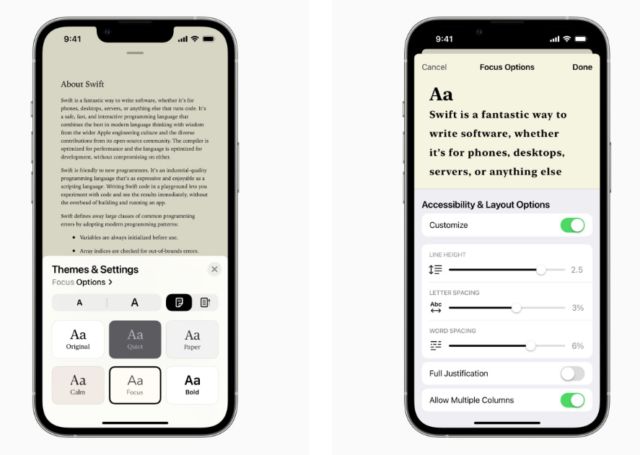

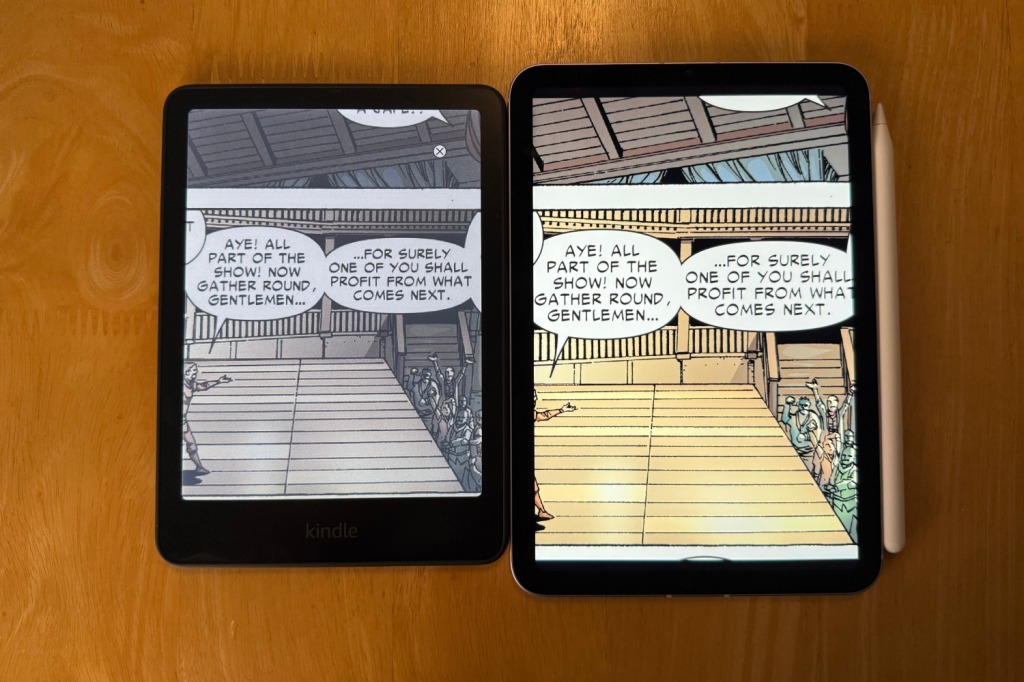

◉ Apple Books 将推出新功能,提供自定义选项,例如加粗文本和调整行、字母和单词间距,以获得无障碍阅读体验。

看看苹果为有决心的人提供了什么,你会发现苹果设备让他们的生活变得更轻松,让他们克服了许多困难。 这取决于科技公司,他们更关注这些人,必须找到新的方法让他们更容易应对周围的环境。

相片:

10条评论