Chaque année, un débat surgit sur ce qu'Apple mettra à jour lors de sa conférence, et ce qui ne le sera pas. Mais certains aspects restent constants, ce qui signifie que nous savons maintenant avec certitude qu'Apple met à jour ses processeurs à chaque conférence. Bien sûr, Apple met à jour l'appareil photo et il s'agit d'un événement très attendu en raison de la concurrence intense.L'époque où Apple pouvait contrôler la qualité de l'appareil photo avec une forte concurrence des appareils Google Pixel, des appareils Samsung et même Huawei. Apple réussira-t-il cette année dans la compétition?

Équipement

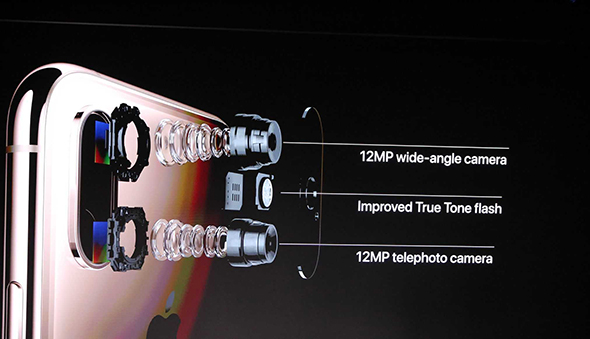

Peut-être sommes-nous habitués à ce que le changement de base d'Apple intervienne dans le domaine du matériel, car Apple fabrique du matériel irréprochable, et généralement nous trouvons également plus d'une mise à jour liée au matériel de la caméra, même si vous trouvez des mises à jour système à côté, et c'est pourquoi le matériel d'Apple m'a surpris cette année. Il n'a en fait pas mis à jour une grande partie du matériel, mais ce qu'il a renouvelé est important, car il a, pour la première fois depuis l'iPhone 5s, augmenté la taille du capteur de la caméra, pas le nombre de pixels, mais plutôt un 12 - capteur mégapixel caractérisé par une taille de pixel plus grande égale à 1.4 microns au lieu des 1.22 microns utilisés dans l'iPhone - IPhone X, qui était la taille de pixel utilisée depuis l'iPhone 6s. En outre, il est fort probable qu'Apple ait modifié les propriétés de l'objectif pour s'adapter à la nouvelle taille de pixel.

Apple dit également que le flash est devenu "plus lumineux" mais sans aucune information supplémentaire et la caméra frontale n'a pas changé sauf pour une nouvelle installation vidéo.

Au-delà du matériel de la caméra

Nous savons ce qui est nouveau dans le matériel de l'appareil photo, mais les appareils Apple de cette année brillent le plus dans la région de l'IA. Alors que le nouveau processeur avec une architecture de 7 nanomètres se concentre clairement sur la puce de réseau neuronal du téléphone, il semble que la plupart des travaux d'Apple se soient concentrés dessus, car la puce de réseau neuronal a maintenant 8 cœurs et peut effectuer cinq trillions d'opérations de traitement par deuxième. Cette avancée est actuellement dans l'intérêt de la réalité augmentée et de la caméra, dans laquelle on sait tirer parti de l'intelligence artificielle qu'elle contient pour améliorer les images. Et ce n'est pas seulement pour les ajouts mignons comme mi-muji. Alors, qu'avons-nous tiré des améliorations apportées au matériel et au système cette année?

Caméra plus intelligente

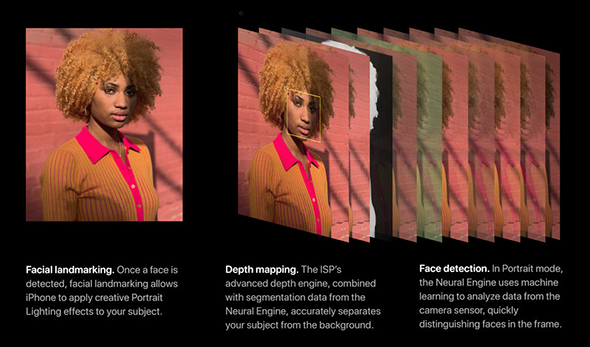

Habituellement, les caméras effectuent des calculs pour l'image afin d'analyser les caractéristiques des visages, des yeux et d'autres détails tels que les éléments à l'avant de l'image et ceux à l'arrière. Et aussi les éléments sur lesquels il faut se concentrer par rapport à ceux sur lesquels on devrait moins se concentrer. C'est ce dans quoi le nouvel iPhone excelle, car l'appareil photo dispose de plus d'informations pour comprendre l'image et l'aider à l'améliorer, comme l'annulation de l'effet yeux rouges et la distinction des limites entre les éléments importants de l'image. L'appareil photo peut également mieux segmenter l'image pour comparer ces parties et générer une meilleure impression de profondeur d'image (même sur des photos ordinaires, parler de nous n'est pas seulement l'effet Bokeh).

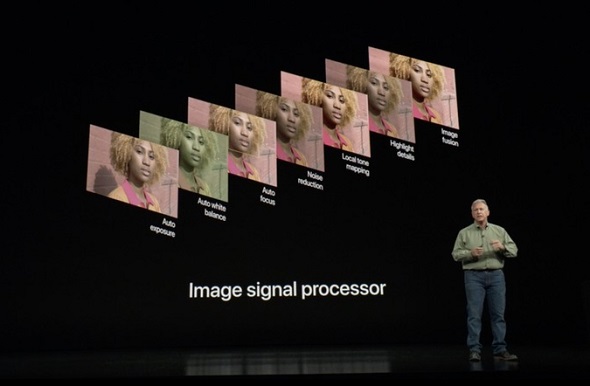

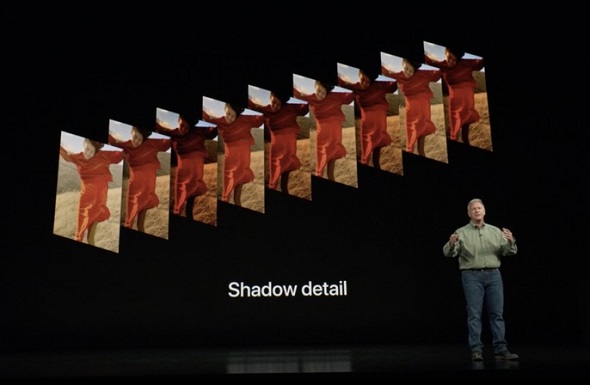

Aussi, Smart HDR

Le HDR est présent dans les appareils photo des téléphones depuis un certain temps et cela signifie que l'appareil photo prend plusieurs photos et les fusionne afin d'obtenir une meilleure image. Et à partir de là, commence à construire Apple pour cette année et un peu similaire à ce que Google a fait avec l'appareil Pixel 2 et le mode HDR +, car l'appareil Google prend de nombreuses photos avec une exposition différente (l'exposition est la quantité de lumière autorisée à entrer), puis choisissez les meilleurs détails grâce à l'intelligence artificielle et les pixels de cette technologie capturent plusieurs photos à faible exposition. Quant à Apple, il utilise des images, dont certaines se caractérisent par une faible exposition et d'autres par une surexposition, afin de mieux sauvegarder les détails des ombres et de les restituer.

Photos instantanées

Apple s'est souvent vanté de la vitesse d'obturation de son appareil photo et de la vitesse à laquelle il prend des photos, mais il y a toujours ce léger retard. Vous remarquerez peut-être ce délai si vous êtes accro à la prise de photos rapides. Si c'est le cas, votre rêve peut être réalisé cette année car la photographie est devenue instantanée, car l'appareil photo prend des photos tout le temps, mais ce sont des photos qui sont prises puis numérisées directement tout le temps jusqu'à ce que vous appuyiez sur le bouton de photographie. l'image n'est pas effacée, mais elle est plutôt enregistrée. C'est ainsi qu'Apple a pu rendre le délai d'enregistrement de l'image après avoir appuyé sur le bouton égal à zéro.

Profondeur variable

L'appareil photo d'Apple depuis l'année dernière, considéré comme le meilleur en termes d'effet de profondeur ou de Bokeh, et encore meilleur que les téléphones à pixels, car le pixel en fin de compte ne dépend que du système, tandis qu'Apple utilise deux objectifs séparés, ce qui donne de meilleurs résultats, mais cette année, grâce aux nouvelles caractéristiques du système, Apple a décidé de permettre au photographe de modifier la profondeur de l'image et l'intensité de l'effet «après» prise. Bien qu'une fonctionnalité similaire ait été trouvée dans d'autres appareils tels que Samsung et même certaines applications iPhone, ces méthodes la modifient uniquement en tant qu'effet. En ce qui concerne l'iPhone XS, les expérimentateurs du téléphone lors de la conférence ont indiqué que changer la profondeur de plusieurs dimensions et qu'il change à différents niveaux dans L'image d'une manière qui simule le changement de la profondeur réelle à l'aide d'un objectif de caméra .. Bien sûr, nous ne serons pas en mesure de faire une comparaison complète jusqu'à ce que l'appareil soit disponible à la vente et jusqu'à ce moment nous dois attendre.

Mieux avec des scènes de faible éclairage et d'action

Étant donné que les pixels de la caméra sont devenus plus grands, cela signifie qu'ils captent plus de lumière. Cela améliore considérablement la photographie dans des conditions de faible éclairage, ainsi que les technologies HDR intelligentes, les réglages d'intelligence artificielle et la vitesse d'obturation de l'appareil photo permettent tous des photos de meilleure qualité et plus stables lors de la photographie de sujets en mouvement.

Et Google Pixel?

![]()

Google sait depuis sa sortie des premiers appareils pixel que son point d'excellence est l'intelligence artificielle soutenue par ses serveurs géants, qui ont accès aux données de centaines de millions d'utilisateurs pour développer son système, et c'est exactement ce que Google a fait. dans l'appareil photo Pixel 2, comme malgré la qualité du matériel de l'appareil photo et de la puce spéciale, mais la plupart des éloges pour cela proviennent de la façon dont l'intelligence du téléphone traite les images afin de sortir de la meilleure façon, et c'est ce qu'Apple essaie de se développer pour cette année, car il a mis une puissance de traitement puissante au service de son système d'intelligence artificielle et est sorti avec les résultats d'aujourd'hui, mais il faut se rappeler que l'iPhone XS ne sera pas comparé à un appareil pixel 2 il est là pour rivaliser avec le prochain Pixel 3. Google a souvent déclaré que son système est illimité au fur et à mesure qu'il apprend avec l'utilisation. Même si Google a développé le même système d'intelligence à partir du Pixel 2 annoncé il y a un an, il devrait être mieux cette fois lorsqu'il est utilisé dans le nouveau téléphone. En outre, Google, bien sûr, peut ajouter des fonctionnalités au matériel de la caméra afin d'augmenter la puissance de l'intelligence artificielle supplémentaire et de produire des images capables de vaincre l'iPhone.

Enfin, l'écosystème Google est fortement en mesure de s'étendre en permanence grâce à ses serveurs géants, d'accéder aux données des utilisateurs et de les étudier pour nourrir son esprit de réflexion. Quant à Apple, il limite l'intelligence artificielle à ses propres conditions de confidentialité, de sorte que la plupart des processus d'apprentissage et de traitement se déroulent dans le téléphone sans serveurs, de sorte qu'il met toute cette énergie dans les processeurs spécifiquement à cette fin. Avec cette philosophie, Apple peut-il battre Google? Bientôt, nous comparons avec nos yeux. Mais n'oubliez pas que dans un mois, nous verrons également le téléphone Google Pixel 3.

Que pensez-vous de ce que j'ai lu sur le nouvel appareil photo de l'iPhone XS? Cela en fait-il un facteur d'achat essentiel?

Source:

56 commentaire